Home

»

Genel

» Yerli yapay zeka “Kumru” kullanıma sunuldu!

Yerli yapay zeka “Kumru” kullanıma sunuldu!

| Ekim 12, 2025 |

Posted by SiberBulucu.Com

under

Genel

|

|

Türk mühendisler, metin işleme, özetleme ve soru-cevap gibi görevleri gerçekleştirebilen yerli yapay zekâ modeli Kumru’yu geliştirdi. ChatGPT’ye benzer özellikler taşıyan modelin kullanıma sunulmasıyla birlikte, Kumru’nun ChatGPT’ye rakip olup olamayacağı yönündeki tartışmalar gündeme taşındı.

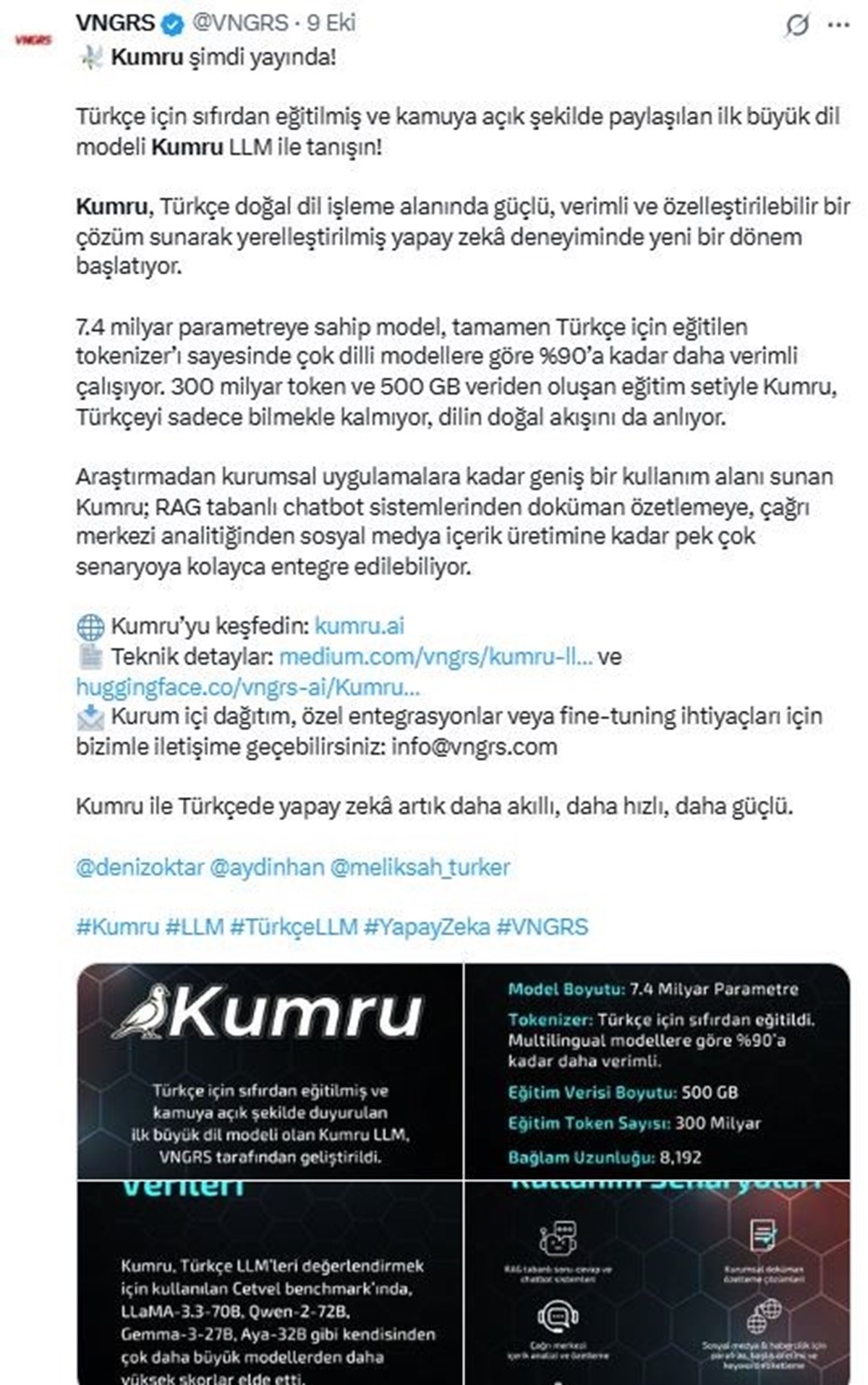

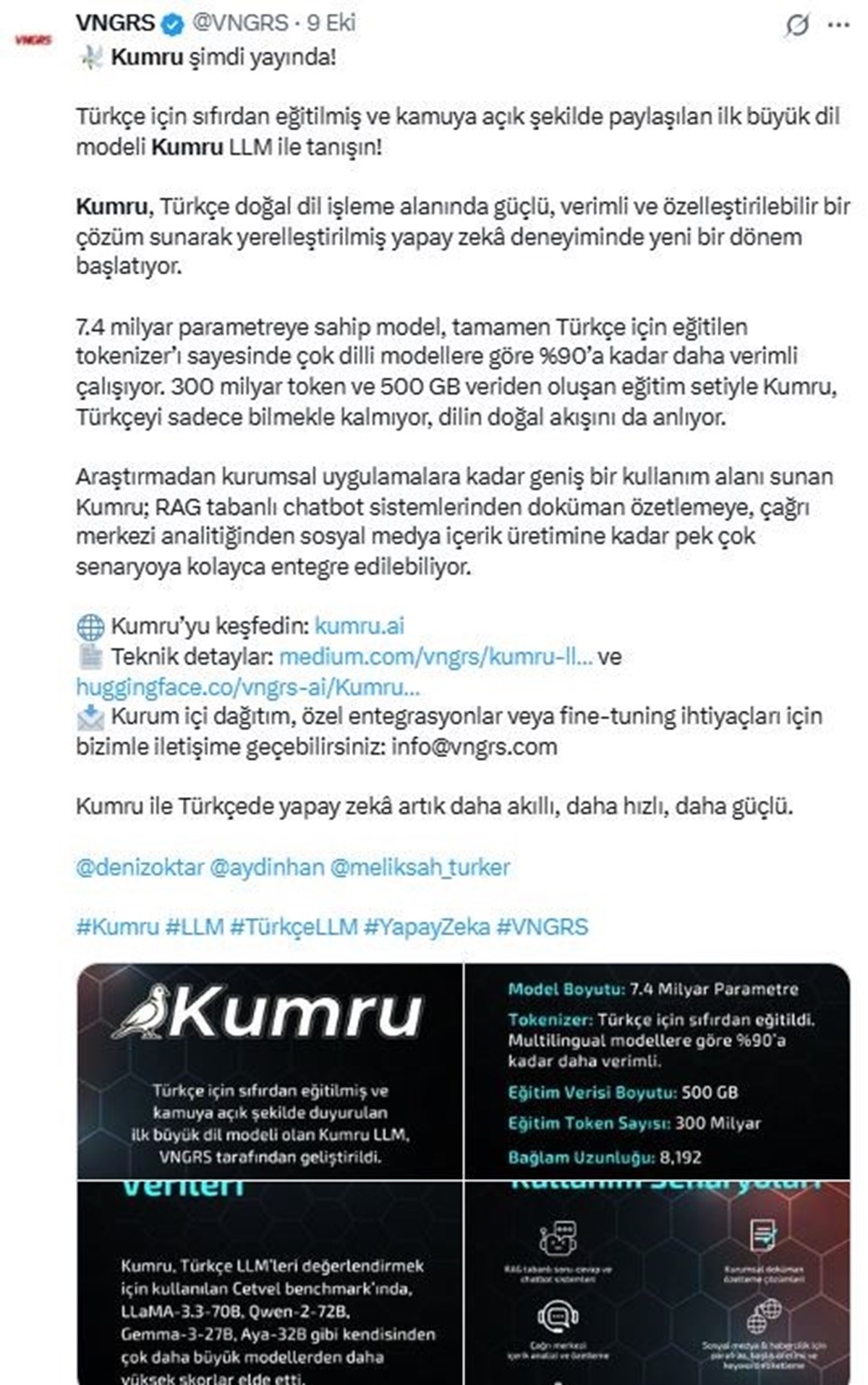

Türkçe doğal dil işleme alanında yeni bir dönem başlatacak olan Kumru LLM, tamamen Türkçe verilerle eğitilen ilk büyük dil modeli olarak duyuruldu. VNGRS tarafından geliştirilen model, 7,4 milyar parametreye sahip yapısıyla Türkçe odaklı yapay zekâ çalışmalarında yerelleştirilmiş, verimli ve özelleştirilebilir bir çözüm sunuyor. Kumru’nun yalnızca Türkçe için eğitilen tokenizer yapısı sayesinde çok dilli modellere göre %90’a kadar daha verimli çalıştığı belirtiliyor. Model, 300 milyar token ve 500 GB veri içeren geniş bir eğitim setiyle oluşturuldu. Böylece Kumru’nun Türkçenin yalnızca sözcük yapısını değil, dilin doğal akışını da anlayabildiği ifade ediliyor. Araştırmadan kurumsal uygulamalara kadar geniş bir kullanım alanına sahip olan Kumru; RAG tabanlı sohbet sistemleri, doküman özetleme, çağrı merkezi analitiği ve sosyal medya içerik üretimi gibi pek çok alanda kullanılabiliyor.

Türk mühendisler, metin işleme, özetleme ve soru-cevap gibi görevleri gerçekleştirebilen yerli yapay zekâ modeli Kumru’yu geliştirdi. ChatGPT’ye benzer özellikler taşıyan modelin kullanıma sunulmasıyla birlikte, Kumru’nun ChatGPT’ye rakip olup olamayacağı yönündeki tartışmalar gündeme taşındı.

Türkçe doğal dil işleme alanında yeni bir dönem başlatacak olan Kumru LLM, tamamen Türkçe verilerle eğitilen ilk büyük dil modeli olarak duyuruldu. VNGRS tarafından geliştirilen model, 7,4 milyar parametreye sahip yapısıyla Türkçe odaklı yapay zekâ çalışmalarında yerelleştirilmiş, verimli ve özelleştirilebilir bir çözüm sunuyor. Kumru’nun yalnızca Türkçe için eğitilen tokenizer yapısı sayesinde çok dilli modellere göre %90’a kadar daha verimli çalıştığı belirtiliyor. Model, 300 milyar token ve

Alıntının kaynağı: NTV.Com.Tr